Aktivera datasäkerhet vid användning av AI-lösningar

Från personliga produktrekommendationer till att driva autonoma fordon, artificiell intelligens förändrar snabbt industrier, driver innovationer och formar vårt dagliga liv. Men AI är inte så självförsörjande som det verkar, och dess kapacitet är bara lika bra som dess tillgång till data.

I takt med att generativa AI-system blir mer sofistikerade och datahungriga förlitar de sig på stora mängder känslig ostrukturerad data, från kunddata till interna rapporter, för att fungera effektivt. Detta ökar risken för missbruk, exponering eller intrång, vilket gör robust datasäkerhet inte bara viktig, utan avgörande för säker och ansvarsfull användning av AI.

Nyligen genomförda undersökningar visar att 96% av organisationerna bygger styrning för generativ AI, och 82% oroar sig för dataläckage från dessa verktyg. För företagsledare är frågan hur man använder AI-verktyg i sina affärsprocesser utan att avslöja företagshemligheter, konfidentiella data eller kundinformation.

Hur AI-lösningar kan äventyra datasäkerheten

Att säkerställa datasäkerhet när du använder AI handlar inte bara om att förhindra intrång, det handlar om att förstå hur känslig information oavsiktligt kan läcka genom daglig användning. När AI blir inbäddad i affärsflöden uppstår risker inte bara under utveckling och distribution, utan också i hur anställda interagerar med dessa verktyg och hur AI-system är strukturerade för att lära sig och svara.

Till exempel kan en anställd klistra in konfidentiella siffror, kundinformation eller källkod i ett generativt AI-verktyg för att få en snabb analys, omedveten om att dessa data kan lagras, bearbetas eller återanvändas utanför deras kontroll. Samtidigt kan AI-modeller själva ibland behålla och reproducera fragment av känslig träningsdata. Det här är inte edge-fall, det är systemrisker som uppstår vid normal användning i avsaknad av lämpliga skyddsåtgärder.

Till skillnad från traditionella cyberattacker sker dessa läckor ofta utan att någon inser det. En nyligen Gartner-rapport framhäver att AI-chatbots, utan strikta protokoll, oavsiktligt kan avslöja privata data lagrade i företagssystem. Det är därför som att säkra AI börjar med att bädda in tydliga policyer, åtkomstkontroller och övervakning av hur dessa verktyg används i hela organisationen.

Till skillnad från traditionell datasäkerhet, som fokuserar på att skydda statiska datamängder, måste AI-datasäkerhet hantera unika utmaningar:

- Höga krav på datavolym: AI-modeller förlitar sig på storskaliga data, vilket ökar ytan för potentiella läckor.

- Overifierade datakällorData som används av AI kommer vanligtvis från flera källor, som ibland är obekräftade, vilket komplicerar säkerhetsarbetet.

- Kontradiktoriska hot: Skadliga ingångar kan manipulera AI-modeller, vilket leder till felaktiga utgångar eller komprometterade system.

- Utökad attackytaKomplexiteten i AI-system, inklusive modeller, API:er och molninfrastruktur, skapar fler ingångspunkter för angripare.

Tillsammans kräver dessa faktorer en förändring i hur organisationer närmar sig datasäkerhet när de använder AI. Det innebär robusta strategier som säkerställer dataintegritet, konfidentialitet och efterlevnad av regler som General Data Protection Regulation (GDPR) och California Consumer Privacy Act (CCPA). Verkliga incidenter, till exempel exponering av 38 TB Microsoft-data av AI-forskare, lyfta fram insatserna.

5 metoder för att minska datarisker vid integration av AI

Datasäkerhetsproblem bör inte betraktas som en anledning att undvika att använda AI, de är en anledning att använda det klokt. Eftersom AI-användning blir oundviklig för alla affärsfunktioner är målet inte att bromsa innovationen, utan att integrera den på ett ansvarsfullt sätt. Genom att vidta proaktiva åtgärder för att säkra känslig information kan företag frigöra den fulla potentialen hos AI-verktyg utan att utsätta sig för onödiga risker. Här är fem grundläggande metoder som hjälper dig att implementera AI säkert, i stor skala.

- Upprätta ett tydligt ramverk för AI-datastyrning

Definiera ägande, policyer och arbetsflöden kring varje AI-projekt. Klassificera data efter känslighet och kartlägg vem som kan komma åt dem, under vilka omständigheter och genom vilka godkända AI-slutpunkter. Genom att bädda in AI-styrning i ditt befintliga datastyrningsprogram säkerställer du att varje bot, modell eller API du distribuerar överensstämmer med dina bredare datasäkerhetsmandat. - Utnyttja tekniska kontroller och övervakning

Kryptera all data i överföring och vila, använd rollbaserad åtkomst för AI-verktyg och använd API-gateways för att centralisera och logga alla AI-interaktioner. Implementera realtidsskanning av uppmaningar och utgångar för känsliga nyckelord eller PII (personligt identifierbar information) och kör periodiska ”röda team” -övningar för att testa för läckage. Genom att para ihop kryptering, åtkomstkontroller och automatiserad övervakning skapar du ett motståndskraftigt försvar mot både oavsiktliga dataspill och kontradiktoriska sonderingsattacker. - Undersök och hantera AI-leverantörer från tredje part

Behandla alla externa AI-tjänster som du skulle göra med en kritisk molnleverantör. Lägg till SOC 2- eller ISO 27001-certifiering som ett krav, insistera på avtalsenliga garantier för att kundindata inte kommer att användas för att omskola modeller och föredra driftsättningar i företagsklass eller lokalt som aldrig delar dina data med offentliga system. Shadow-AI-riskerna försvinner när du erbjuder säkra, godkända alternativ och genomför enkel inloggning (SSO) eller nätverksbegränsningar. - Bädda in integritetsförbättrande teknik

När det är möjligt, välj AI-lösningar som stöder differentiell integritet, dataanonymisering eller federerat lärande. Dessa tekniker suddar ut länken mellan frågor och originaldata, minskar effektiviteten av modellinversions- eller medlemsinferensattacker och hjälper till att säkerställa pågående GDPR, CCPA eller annan efterlevnad. - Integrera AI i dina risk- och efterlevnadsprogram

Utöka företagets riskbedömningar och insatsplaner för att täcka AI-specifika scenarier. Dokumentera varje dataflöde in och ut ur dina AI-system, genomför konsekvensbedömningar av dataskydd för högriskanvändningsfall och utbilda ditt incidentsvarsteam att hantera AI-relaterade överträdelser tillsammans med traditionella cyberhändelser.

Hur en iPaas-lösning hjälper till att integrera AI säkert

När företag använder AI-verktyg för att förbättra arbetsflöden, från automatisering av kundservice till prognoser i försörjningskedjan, stöter de ofta på en kritisk utmaning: hur man ansluter dessa verktyg till interna system och datakällor utan att kompromissa med känslig information. Det är här och iPaaS-lösningar (integration Platform as a Service) förenklar AI-integrationer och datasäkerhet avsevärt.

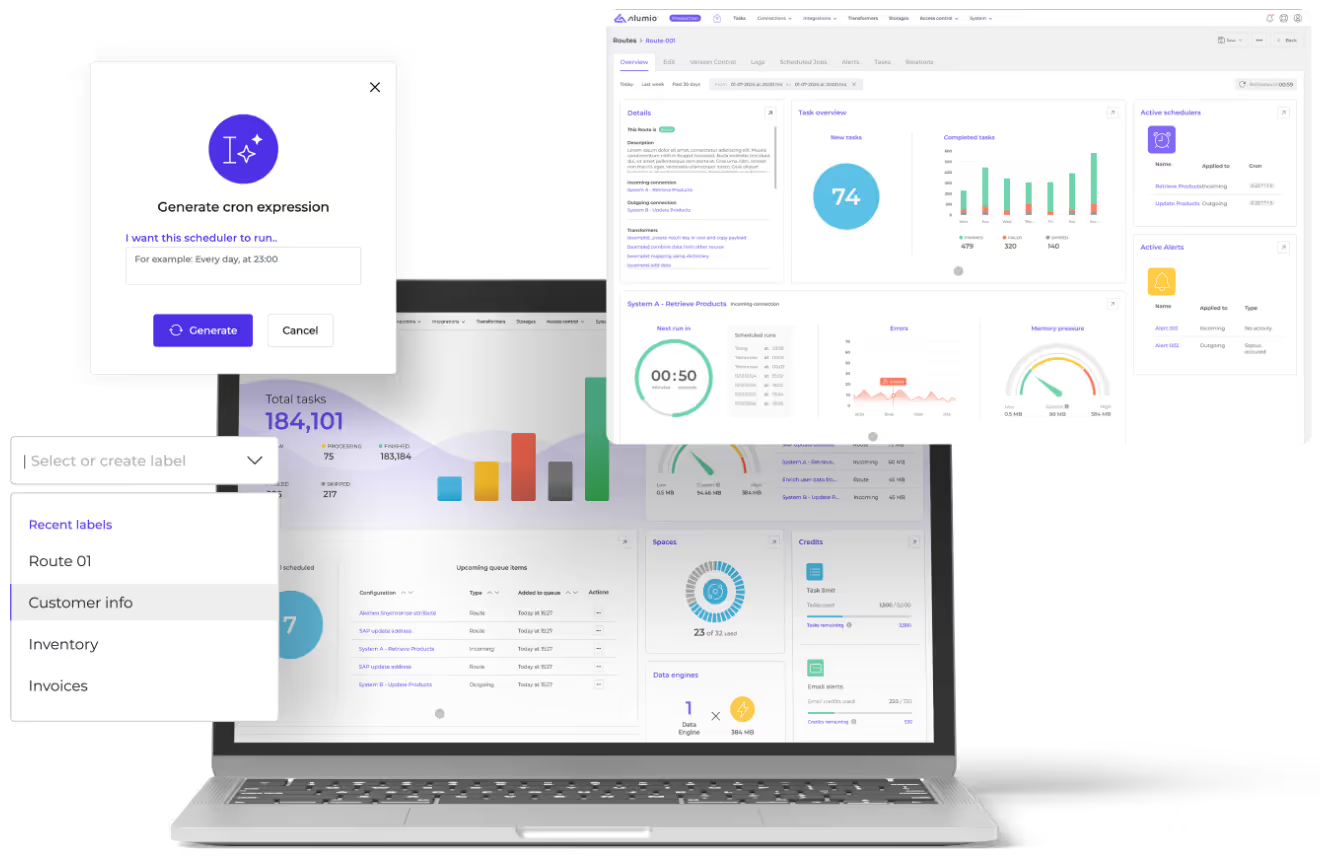

Alumio är en API-driven molnbaserad iPaaS, eller integrationsplattform, utformad för att ansluta system, omvandla data och automatisera arbetsflöden över hela ditt IT-landskap. Det gör det möjligt för organisationer att på ett säkert sätt anslut AI-verktyg som OpenAI till ERP-system, e-handelsplattformar, CRM och databaser, utan att skriva anpassad kod eller exponera rådata.

När AI integreras kommer en ISO 27001 iPaaS-lösning som Alumio redan med flera viktiga inbyggda datasäkerhetsåtgärder som hjälper till att minska datariskerna för AI-användning på följande sätt:

- Kontrollera åtkomst till data genom att använda iPaaS som ett säkert lager mellan AI-verktyg och dina kärnsystem. Endast godkända och relevanta data skickas igenom, med finkorniga behörigheter och rollbaserade filter som tillämpas före exponering.

- Övervaka och logga data i varje datatransaktion, vilket säkerställer spårbarhet och granskbarhet för varje prompt, inmatning eller svar som passerar genom ett AI-anslutet arbetsflöde.

- Centralisera API-anslutningar för att få full insyn i vilka data som delas, med vem och när, vilket minskar risken för skuggverktyg eller obehörig åtkomst.

- Tvinga autentisering i företagsklass (SSO, tokenhantering, krypterade nycklar) så att AI-verktyg endast kan komma åt data och system som tillåts.

- Automatisera efterlevnadskontroller genom att bädda in valideringssteg i datarutter för att säkerställa att varje integration uppfyller lagstadgade och interna standarder.

Kort sagt, Alumio iPaaS tillhandahåller infrastrukturen för att ansluta AI-verktyg säkert och ansvarsfullt, så att dina team kan automatisera och innovera, utan att äventyra efterlevnad eller känsliga data.

Bädda in säkerhet i DNA för AI-integration

Att göra datasäkerheten effektiv i AI-åldern innebär att man inbäddar skyddsåtgärder i varje fas av införandet, från hur AI-verktyg väljs, till hur de integreras, till hur de används dagligen mellan team. Det handlar inte bara om att försvara sig mot externa hot som intrång eller motstridiga attacker, det handlar om att bygga ansvarsfulla system inifrån och ut. Detta börjar med tydliga policyer: definiera vilka data som kan delas med AI-verktyg, utbilda team om säkra uppmaningsvanor och tillämpa strikta riktlinjer för hur offentliga eller tredjepartsmodeller nås.

Lägg sedan på rätt tekniska kontroller. Klassificera känsliga data, tillämpa kryptering, begränsa AI-åtkomst baserat på roller och implementera verktyg för att övervaka uppmaningar och flagga exponerade personliga eller proprietära data. Det viktigaste är att välja AI-verktyg och integrationslösningar som Alumio iPaaS som prioriterar säkerhet i företagsklass. Genom att implementera stark styrning, tekniska skyddsåtgärder och kontrollerade AI-arbetsflöden kan företag frigöra AI: s fulla potential, utan att kompromissa med efterlevnad, kundernas förtroende eller IP.