Gegevensbeveiliging mogelijk maken bij gebruik van AI-oplossingen

Van gepersonaliseerde productaanbevelingen tot het aandrijven van autonome voertuigen, kunstmatige intelligentie transformeert industrieën snel, stimuleert innovaties en geeft vorm aan ons dagelijks leven. Maar AI is niet zo zelfvoorzienend als het lijkt, en de mogelijkheden zijn slechts zo goed als de toegang tot de gegevens.

Naarmate generatieve AI-systemen geavanceerder worden en meer gegevens nodig hebben, zijn ze afhankelijk van grote hoeveelheden gevoelige ongestructureerde gegevens, van klantgegevens tot interne rapporten, om effectief te kunnen functioneren. Dit verhoogt het risico op misbruik, blootstelling of inbreuken, waardoor robuuste gegevensbeveiliging niet alleen belangrijk is, maar ook essentieel is voor een veilige en verantwoorde toepassing van AI.

Recente enquêtes laat zien dat 96% van de organisaties bezig is met het opbouwen van governance voor generatieve AI, en 82% maakt zich zorgen over datalekken via deze tools. Voor bedrijfsleiders is de vraag hoe ze AI-tools in hun bedrijfsprocessen kunnen toepassen zonder bedrijfsgeheimen, vertrouwelijke gegevens of klantinformatie prijs te geven.

Hoe AI-oplossingen de gegevensbeveiliging in gevaar kunnen brengen

Het waarborgen van gegevensbeveiliging bij het gebruik van AI gaat niet alleen over het voorkomen van inbreuken, het gaat erom te begrijpen hoe gevoelige informatie onbedoeld kan lekken bij dagelijks gebruik. Naarmate AI ingebed raakt in bedrijfsworkflows, ontstaan er niet alleen risico's tijdens de ontwikkeling en implementatie, maar ook in de manier waarop werknemers omgaan met deze tools en hoe AI-systemen zijn gestructureerd om te leren en te reageren.

Een werknemer kan bijvoorbeeld vertrouwelijke cijfers, klantinformatie of broncode in een generatieve AI-tool plakken om een snelle analyse te krijgen, zonder te weten dat deze gegevens buiten hun controle kunnen worden opgeslagen, verwerkt of hergebruikt. Ondertussen kunnen AI-modellen zelf soms fragmenten van gevoelige trainingsgegevens bewaren en reproduceren. Dit zijn geen randgevallen, het zijn systemische risico's die voortkomen uit normaal gebruik zonder de juiste waarborgen.

In tegenstelling tot traditionele cyberaanvallen gebeuren deze lekken vaak zonder dat iemand het beseft. Een recente Gartner-rapport benadrukt dat AI-chatbots zonder strikte protocollen onbedoeld privégegevens kunnen blootleggen die zijn opgeslagen in bedrijfssystemen. Daarom begint het beveiligen van AI met het verankeren van duidelijk beleid, toegangscontroles en monitoring in de manier waarop deze tools in de hele organisatie worden toegepast.

In tegenstelling tot traditionele gegevensbeveiliging, die zich richt op de beveiliging van statische datasets, moet AI-gegevensbeveiliging unieke uitdagingen aanpakken:

- Vereisten voor hoge gegevensvolumes: AI-modellen zijn afhankelijk van grootschalige gegevens, waardoor het oppervlak voor mogelijke lekken groter wordt.

- Niet-geverifieerde gegevensbronnen: Gegevens die door AI worden gebruikt, zijn doorgaans afkomstig van meerdere bronnen, die soms niet geverifieerd zijn, wat de beveiligingsinspanningen bemoeilijkt.

- Tegenstrijdige bedreigingen: Kwaadaardige inputs kunnen AI-modellen manipuleren, wat leidt tot onjuiste output of gecompromitteerde systemen.

- Uitgebreid aanvalsoppervlak: De complexiteit van AI-systemen, waaronder modellen, API's en cloudinfrastructuur, creëert meer toegangspunten voor aanvallers.

Samen vereisen deze factoren een verschuiving in de manier waarop organisaties omgaan met gegevensbeveiliging bij het gebruik van AI. Het omvat robuuste strategieën die de integriteit, vertrouwelijkheid en naleving van voorschriften zoals de General Data Protection Regulation (GDPR) en de California Consumer Privacy Act (CCPA) waarborgen. Incidenten uit de echte wereld, zoals de blootstelling van 38 TB aan Microsoft-gegevens door AI-onderzoekers, benadrukken wat er op het spel staat.

5 praktijken om datarisico's te beperken bij de integratie van AI

Bezorgdheid over gegevensbeveiliging mag niet worden beschouwd als een reden om AI te vermijden, maar als een reden om het verstandig te gebruiken. Nu AI-adoptie onvermijdelijk wordt voor alle bedrijfsfuncties, is het doel niet om innovatie te vertragen, maar om deze op een verantwoorde manier te integreren. Door proactieve maatregelen te nemen om gevoelige informatie te beveiligen, kunnen bedrijven het volledige potentieel van AI-tools benutten, zonder zichzelf bloot te stellen aan onnodige risico's. Hier zijn vijf fundamentele praktijken om u te helpen AI veilig en op grote schaal te implementeren.

- Zorg voor een duidelijk AI-kader voor gegevensbeheer

Definieer eigendom, beleid en workflows voor elk AI-project. Classificeer gegevens op basis van gevoeligheid en breng in kaart wie er toegang toe heeft, onder welke omstandigheden en via welke goedgekeurde AI-eindpunten. Door AI-beheer in uw bestaande programma voor gegevensbeheer te integreren, zorgt u ervoor dat elke bot, elk model of elke API die u implementeert, aansluit bij uw bredere gegevensbeveiligingsmandaten. - Maak gebruik van technische controles en monitoring

Versleutel alle gegevens tijdens het transport en in rust, zorg voor op rollen gebaseerde toegang voor AI-tools en gebruik API-gateways om elke AI-interactie te centraliseren en te registreren. Voer een realtime scan van prompts en outputs uit op gevoelige trefwoorden of PII (Persoonlijk Identificeerbare Informatie), en voer periodieke „red-team” -oefeningen uit om te testen op lekkage. Door versleuteling, toegangscontroles en geautomatiseerde bewaking te combineren, creëert u een veerkrachtige bescherming tegen zowel onbedoelde datalekken als aanvallen met wederhoor. - Controleer en beheer externe AI-leveranciers

Behandel elke externe AI-service zoals u een kritieke cloudleverancier zou behandelen. Voeg een SOC 2- of ISO 27001-certificering toe als vereiste, dring aan op contractuele garanties dat de input van klanten niet wordt gebruikt om modellen bij te scholen, en geef de voorkeur aan implementaties op bedrijfsniveau of op locatie waarbij uw gegevens nooit worden gedeeld met openbare systemen. SchaduwAI-risico's verdwijnen wanneer u veilige, goedgekeurde alternatieven aanbiedt en eenmalige aanmelding (SSO) of netwerkbeperkingen afdwingt. - Integreer privacyverhogende technologieën

Kies waar mogelijk AI-oplossingen die differentiële privacy, anonimisering van gegevens of federatief leren ondersteunen. Deze technieken vervagen de link tussen zoekopdrachten en originele gegevens, verminderen de effectiviteit van modelinversie- of lidmaatschapsinferentieaanvallen en dragen bij aan de voortdurende naleving van de AVG, CCPA of andere voorschriften. - Integreer AI in uw risico- en nalevingsprogramma's

Breid uw bedrijfsrisicobeoordelingen en incidentresponsplannen uit om AI-specifieke scenario's te dekken. Documenteer elke gegevensstroom naar en uit uw AI-systemen, voer gegevensbeschermingseffectbeoordelingen uit voor risicovolle gebruikssituaties en train uw incidentresponsteam om AI-gerelateerde inbreuken naast traditionele cybergebeurtenissen aan te pakken.

Hoe een iPaaS-oplossing helpt om AI veilig te integreren

Nu bedrijven AI-tools gebruiken om workflows te verbeteren, van automatisering van klantenservice tot prognoses van de toeleveringsketen, komen ze vaak voor een cruciale uitdaging te staan: hoe kunnen ze deze tools koppelen aan interne systemen en gegevensbronnen zonder gevoelige informatie in gevaar te brengen. Dit is waar iPaaS-oplossingen (Integration Platform as a Service) AI-integraties en gegevensbeveiliging aanzienlijk vereenvoudigen.

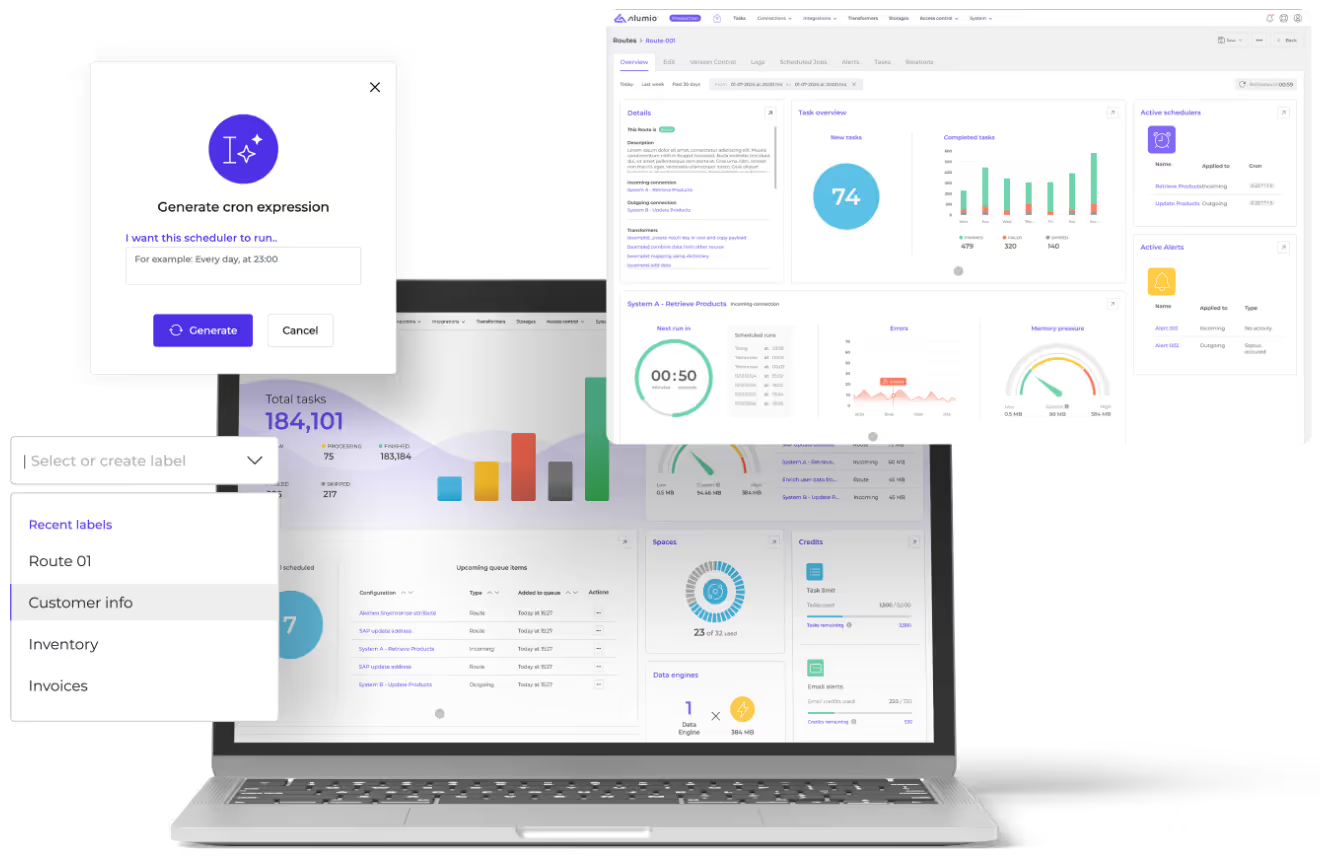

Alumio is een API-gestuurd cloud-native iPaaS, of integratieplatform, ontworpen om systemen te verbinden, gegevens te transformeren en workflows in uw IT-landschap te automatiseren. Het stelt organisaties in staat om veilig verbind AI-tools zoals OpenAI naar ERP-systemen, e-commerceplatforms, CRM's en databases, zonder aangepaste code te schrijven of onbewerkte gegevens vrij te geven.

Bij de integratie van AI bevat een ISO 27001 iPaaS-oplossing zoals Alumio al verschillende cruciale ingebouwde gegevensbeveiligingsmaatregelen die op de volgende manieren helpen de gegevensrisico's van AI-gebruik te verminderen:

- Beheer de toegang tot gegevens door de iPaaS te gebruiken als een veilige laag tussen AI-tools en je kernsystemen. Alleen goedgekeurde en relevante gegevens worden doorgegeven, waarbij vóór elke blootstelling fijnmazige machtigingen en op rollen gebaseerde filters worden toegepast.

- Gegevens controleren en registreren bij elke datatransactie, waarbij traceerbaarheid en controleerbaarheid wordt gegarandeerd voor elke prompt, invoer of reactie die via een AI-verbonden workflow verloopt.

- API-verbindingen centraliseren om volledig inzicht te krijgen in welke gegevens worden gedeeld, met wie en wanneer, waardoor het risico op schaduwtools of ongeoorloofde toegang wordt beperkt.

- Authenticatie op bedrijfsniveau afdwingen (SSO, tokenbeheer, versleutelde sleutels) zodat AI-tools alleen toegang hebben tot gegevens en systemen zoals toegestaan.

- Nalevingscontroles automatiseren door validatiestappen in dataroutes in te bedden om ervoor te zorgen dat elke integratie voldoet aan de wettelijke en interne normen.

Kortom, de Alumio iPaaS biedt de infrastructuur om AI-tools veilig en verantwoord met elkaar te verbinden, zodat uw teams kunnen automatiseren en innoveren, zonder compliance of gevoelige gegevens in gevaar te brengen.

Beveiliging verankeren in het DNA van AI-integratie

Om gegevensbeveiliging effectief te maken in het tijdperk van AI, moeten beveiligingsmaatregelen worden ingebouwd in elke fase van de adoptie, van de manier waarop AI-tools worden gekozen tot hoe ze worden geïntegreerd, tot hoe ze dagelijks in teams worden gebruikt. Het gaat niet alleen om de verdediging tegen externe bedreigingen, zoals inbreuken of aanvallen van buitenaf, maar ook om het bouwen van verantwoorde systemen van binnenuit. Dit begint met een duidelijk beleid: bepaal welke gegevens kunnen worden gedeeld met AI-tools, onderricht teams over veilige aansporingsgewoonten en pas strikte richtlijnen toe voor de toegang tot openbare modellen of modellen van derden.

Breng vervolgens de juiste technische bedieningselementen aan. Classificeer gevoelige gegevens, dwing versleuteling af, beperk AI-toegang op basis van rollen en implementeer tools om aanwijzingen te controleren en blootgestelde persoonlijke of bedrijfseigen gegevens te markeren. Selecteer vooral AI-tools en integratieoplossingen zoals de Alumio iPaaS die prioriteit geven aan beveiliging op bedrijfsniveau. Door sterk bestuur, technische beveiligingsmaatregelen en doorgelichte AI-workflows te implementeren, kunnen bedrijven het volledige potentieel van AI benutten, zonder afbreuk te doen aan de naleving, het vertrouwen van de klant of IP.