Intégration des données de fabrication : synchronisées, asynchrones, par lots et pilotées par des événements

Avant de choisir un modèle d'intégration spécifique pour traiter les données de fabrication, la première question concerne généralement le calendrier. Certaines intégrations de fabrication ont besoin d'une réponse directe avant de passer à l'étape suivante. D'autres peuvent envoyer des données et poursuivre le traitement sans attendre. C'est pourquoi les intégrations de fabrication relèvent soit du synchrone ou asynchrone catégories d'échange de données.

Synchrone ou asynchrone : le choix fondamental

Dans la pratique, les environnements de fabrication ont besoin de ces deux modèles d'intégration (synchronisation et asynchrone). L'essentiel est d'appliquer le bon modèle au bon flux de travail :

Communication synchrone oblige le système demandeur à faire une pause et à attendre une réponse directe du système récepteur avant de continuer. Cela garantit une validation immédiate des données mais crée une dépendance : si le système récepteur est lent ou indisponible, le système demandeur est bloqué jusqu'à son expiration.

Communication asynchrone permet au système demandeur d'envoyer un message et de poursuivre ses opérations sans attendre de réponse. Le système récepteur traite les données à son propre rythme. Cela permet d'éviter le blocage et d'améliorer le débit, mais nécessite une gestion des erreurs plus minutieuse pour détecter les transferts échoués ou retardés.

Comprendre cette distinction est le point de départ pour concevoir une architecture de données de fabrication fiable. Les cinq motifs ci-dessous s'inscrivent chacun dans l'un de ces deux modèles.

Quand utiliser les 5 modèles d'intégration dans les opérations de fabrication

1. Demande/réponse pour des validations critiques

Le modèle de demande/réponse est l'exemple le plus clair de communication synchrone. Un système envoie une demande, attend une réponse et ne poursuit ses activités que lorsqu'il a reçu les informations dont il a besoin.

Ce modèle est utile lorsqu'un processus ne peut pas se dérouler en toute sécurité sans confirmation.

Exemple de cas d'utilisation : Un système de production peut avoir besoin de vérifier la disponibilité des matériaux avant de publier un bon de travail. L'ERP envoie une demande à l'entrepôt ou au système d'inventaire, attend l'état actuel des stocks, puis décide si la production peut aller de l'avant.

Pourquoi c'est important : La requête/réponse permet de garantir une validation immédiate, mais elle introduit également une dépendance. Si le système cible est lent ou indisponible, le système demandeur est également retardé.

2. Fire-and-Forget pour ne pas bloquer les données des machines et des capteurs

Le Fire-and-Forget est un schéma asynchrone courant dans lequel un système envoie des données et continue de fonctionner sans attendre de réponse.

Cela convient parfaitement aux flux de données volumineux pour lesquels l'expéditeur ne doit pas être bloqué par des retards de réseau ou de traitement.

Exemple de cas d'utilisation : Un automate programmable ou un capteur IoT peut envoyer des données de température, de vibrations ou d'état de la machine à une plateforme d'enregistrement ou d'analyse centralisée sans attendre la confirmation que chaque message a été traité.

Pourquoi c'est important : Ce modèle favorise le débit et évite de ralentir les machines ou les appareils périphériques en cas d'attente inutile. Le compromis est que la fiabilité dépend davantage du middleware ou de la couche de file d'attente qui gère correctement la distribution.

3. Traitement par lots pour de gros volumes de données opérationnelles et financières

Le traitement par lots regroupe les données sur une période définie et les transfère à intervalles réguliers au lieu d'envoyer chaque enregistrement immédiatement.

Cela reste très pertinent dans le secteur de la fabrication, en particulier pour les processus qui ne nécessitent pas d'action réelle.

Exemple de cas d'utilisation : Un système d'exécution de la fabrication peut collecter les heures de travail, la consommation de matériaux et le rendement de production tout au long d'un quart de travail, puis transférer ces données à l'ERP à la fin du quart de travail ou pendant la nuit à des fins de rapprochement et de reporting.

Pourquoi c'est important : Le traitement par lots réduit la charge constante sur les systèmes et est efficace pour les grands volumes de données. Le compromis est la latence : le système récepteur ne voit pas ces mises à jour avant la prochaine exécution planifiée.

4. Architecture pilotée par les événements pour les réactions multisystèmes

L'architecture pilotée par les événements est un modèle asynchrone dans lequel un système publie un événement et plusieurs systèmes abonnés réagissent à celui-ci.

Au lieu de câbler directement les systèmes, l'architecture permet à plusieurs processus en aval de répondre au même déclencheur opérationnel.

Exemple de cas d'utilisation : Lorsqu'une panne de machine survient, cet événement peut être publié une seule fois, puis utilisé pour déclencher différentes actions dans plusieurs systèmes. Les logiciels de maintenance peuvent créer un ticket de service, l'ERP peut ajuster la planification de la production et les systèmes orientés client peuvent signaler d'éventuels retards de livraison.

Pourquoi c'est important : Ce modèle est hautement évolutif et flexible car de nouveaux abonnés peuvent être ajoutés sans modifier le système de publication. Il est particulièrement utile dans le secteur manufacturier où un événement opérationnel peut nécessiter plusieurs réponses commerciales à la fois.

5. Synchronisation en temps réel basée sur des API pour une visibilité du système central

La synchronisation en temps réel basée sur des API est le modèle auquel la plupart des gens pensent lorsqu'ils parlent d'opérations connectées. L'objectif est de mettre à jour les systèmes de base le plus rapidement possible lorsque les données opérationnelles changent.

Cela est particulièrement utile lorsque la visibilité sur l'ensemble des systèmes doit rester à jour.

Exemple de cas d'utilisation : Lorsque les matières premières sont reçues dans le système d'entrepôt, cette mise à jour peut être transmise immédiatement à l'ERP afin que les équipes chargées des achats, de la planification et de la production puissent agir en fonction de la disponibilité actuelle.

Pourquoi c'est important : La synchronisation en temps réel basée sur des API améliore la visibilité et la réactivité, mais elle impose également des exigences accrues en matière de fiabilité, de sécurité et de surveillance de l'intégration. Il fonctionne mieux lorsqu'il est soutenu par une plateforme capable de gérer ces flux de manière cohérente.

Pourquoi aucun modèle d'intégration unique ne suffit dans le secteur manufacturier

Aucun modèle d'intégration unique ne répond à tous les flux de production. Une pile technologique de fabrication résiliente utilise généralement les cinq, chaque modèle étant attribué aux processus qui lui conviennent le mieux.

Request/Reply gère les validations lorsqu'un processus ne peut réellement pas se poursuivre sans données confirmées. Fire-and-Forget prend en charge la télémétrie haut débit lorsque le blocage est inacceptable. Le traitement par lots permet de consolider efficacement de grands ensembles de données pendant les périodes creuses. L'architecture pilotée par les événements coordonne les réponses multisystèmes aux événements opérationnels. Les modèles d'API en temps réel permettent de synchroniser les données d'inventaire, de commande et de production sur les plateformes principales.

La gestion fiable de cette combinaison par le biais de scripts personnalisés et de connexions point à point crée une dette technique qui s'aggrave à mesure que le paysage du système s'agrandit. C'est là qu'une plateforme d'intégration devient particulièrement utile.

Comment une plateforme d'intégration permet de gérer les cinq modèles

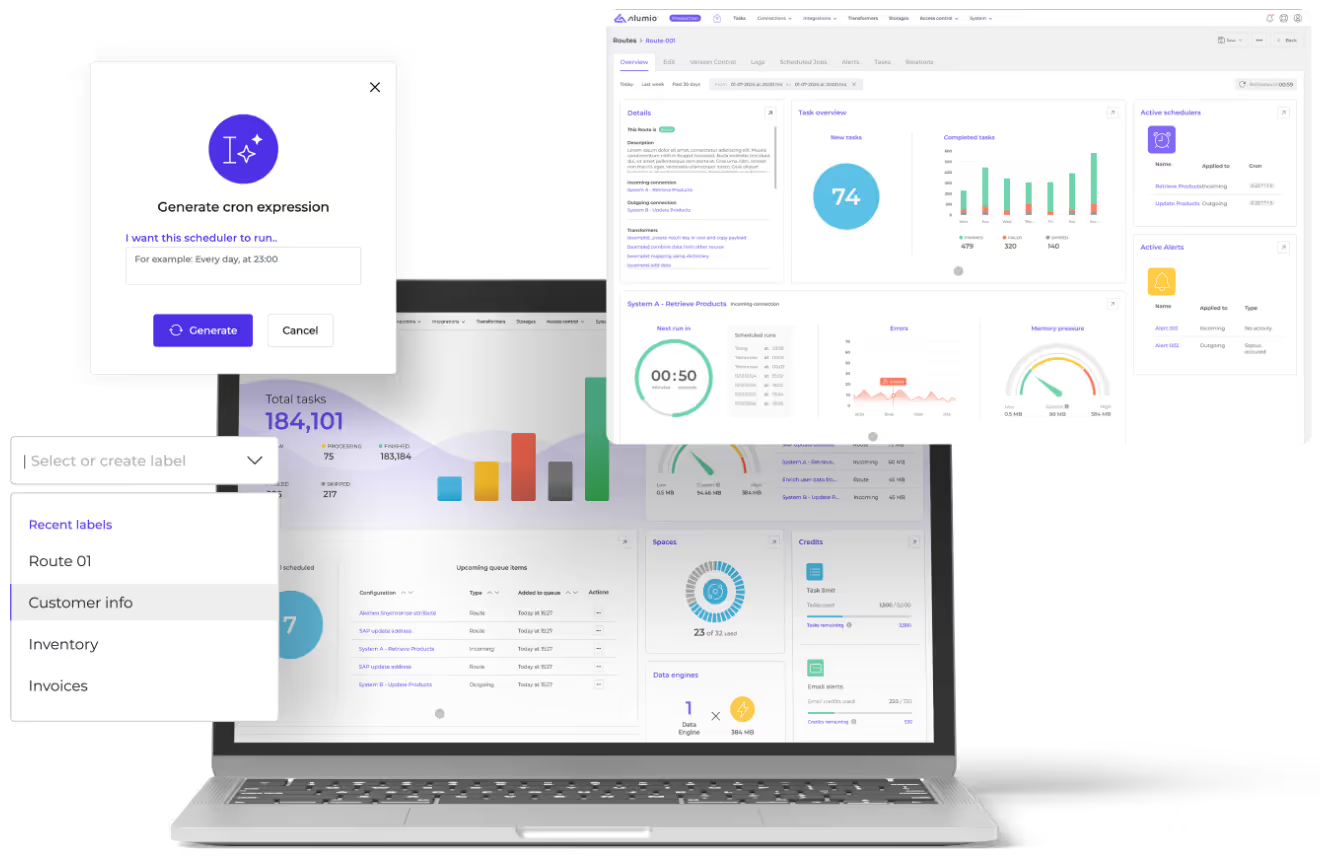

Une plateforme d'intégration centralisée en tant que service (iPaaS) telle qu'Alumio fournit l'infrastructure nécessaire pour configurer, surveiller et gérer les cinq modèles à partir d'une interface unique, avec la visibilité nécessaire pour identifier les défaillances et la flexibilité nécessaire pour s'adapter à l'évolution des systèmes.

Les plateformes telles qu'Alumio sont conçues exactement pour ce type d'environnement de fabrication à modèles multiples, connectant les systèmes ERP, MES, WMS, EAM et autres systèmes opérationnels via une couche d'intégration gouvernée qui prend en charge le flux de données requis par chaque flux de données. Au lieu de s'appuyer sur un code personnalisé fragile entre les systèmes, les fabricants peuvent utiliser la plateforme d'intégration Alumio pour gérer les communications synchrones et asynchrones, le traitement en temps réel et par lots, ainsi que différents modèles de routage via une couche centrale.

C'est important car les intégrations de fabrication restent rarement simples. À mesure que de nouveaux systèmes sont ajoutés, le défi ne consiste pas simplement à les connecter une seule fois. Elle est capable de surveiller, d'adapter et de gérer différents flux de données au fil du temps sans faire de l'architecture une charge de maintenance.

Création d'une architecture de données de fabrication plus résiliente

Les opérations de fabrication n'ont pas besoin d'un modèle d'intégration universel. Ils ont besoin de la flexibilité nécessaire pour utiliser différents modèles là où ils s'adaptent le mieux, qu'il s'agisse de requête/réponse pour une validation critique, de suppression automatique pour la télémétrie, de traitement par lots pour de gros volumes de données de back-office, d'une architecture pilotée par événements pour des réponses coordonnées ou d'une synchronisation en temps réel basée sur des API pour une visibilité opérationnelle en temps réel.

L'important n'est pas de forcer tous les flux de travail à utiliser le même modèle, mais de disposer d'une plateforme d'intégration centrale pour les gérer tous de manière fiable. C'est là qu'Alumio aide. En fournissant une couche d'intégration gouvernée, Alumio permet aux fabricants d'orchestrer différents modèles d'intégration dans le même environnement sans avoir recours à des scripts personnalisés déconnectés ou à une logique point à point difficile à gérer. Il en résulte une architecture de données plus souple et plus résiliente conçue pour assurer la continuité opérationnelle.